特斯拉的整车传感器配置方案

下图是特斯拉官方网站上查到的特斯拉车载传感器配置,足够详细。

上图是特斯拉官方网站上查到的特斯拉车载传感器配置,足够详细。

1. 摄像头

特斯拉车辆标配总共有 8 个摄像头,后面是一个倒车摄像头,前面是一个三目的总成件。两侧一边还有两个。

鱼眼、正常和长焦

后视

中距摄像头实景

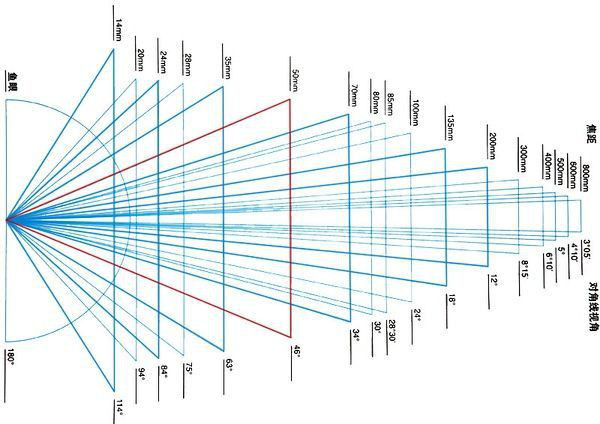

关于不同的镜头是什么关系,引用了知乎上的一张图,请大神看到后联系我们。

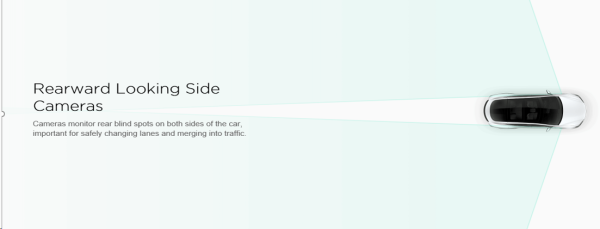

侧视,具体的说是侧视安装的位置,是有特色的。侧后视装在翼子板上,位置靠前;侧前视装在 B 柱,位置在侧后视的安装位置之后 1m。侧前视和侧后视相互重叠,这样就保证了无盲区。这 4 个摄像头就基本保证了 Tesla 的 L3 级别的功能:变道、合流、出高速。从实景照片中可以看出,相邻左右车道确实是无死角的照顾到了。

侧前视

侧后视

侧后视实景

侧前视实景

2. 毫米波雷达

特斯拉的车上,毫米波雷达就装了 1 个,160 米,按照这个探测距离,该雷达是个 77G 的。

特斯拉之前一直仅仅将毫米波定位为一个辅助的传感器,结果撞了大卡车。笔者曾经把特斯拉在 linkedIn 上的人搜了一遍,看看他们是什么背景。结果,一大票人都是常青藤做视觉的 MS 或者 PHD,所以别怪人家把视觉玩的这么溜。

但是,但是,视觉总归是二维的,八个摄像头,同时处理的话,消耗的 GPU 资源不少。结果出事了。还出了不少事。下图这个笔者认为比较经典:

武汉特斯拉自动驾驶撞翻一片护栏

人类都有可能被视觉欺骗,别说机器了。所以摄像头这种通过计算来感知的手段要有,通过直接测量的手段来感知更是必不可少。毫米波雷达和激光雷达,个人认为仪器的成分更多一点,是一个可靠的自动驾驶系统必不可少的。

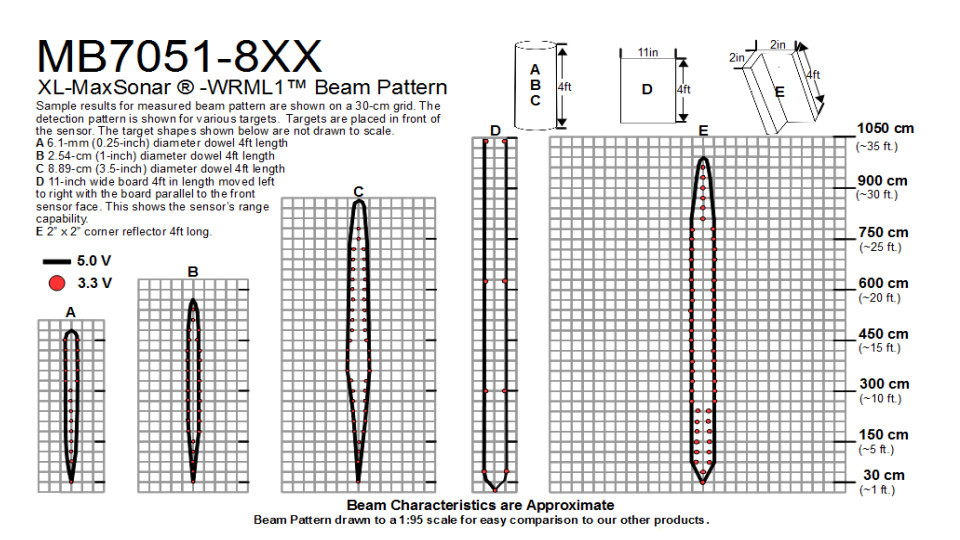

3. 超声波

对于特斯拉来说,在其他地方不起眼的超声波,俺们也要好好用,毕竟测量型传感器除了一个毫米波,就是这 12 个超声波了。笔者曾经和某大佬聊过自动驾驶使用超声波的问题,他觉得超声波精度不行,距离不行,无法用。恩,那能把超声波用在自动驾驶上面的,确实是天才。笔者其实也蛮佩服。转一个知乎上的科普贴:

陈光:无人驾驶技术入门(八)| 被严重低估的传感器超声波雷达

https://zhuanlan.zhihu.com/p/35177313

探测范围 8 米的超声波,找的到吗?献上链接,不敢保证 Tesla 用的就是这家的,但是肯定类似。笔者的朋友当年把这个玩意用在无人机上做壁障,还蛮好用的。那个朋友也是个天才,希望他能在续集里上镜,哈哈。

Ultrasonic Sensors and High Performance Proximity Sensors | MaxBotix

www.maxbotix.com

超声波传感器最大的问题是什么?学过通信的人应该知道复用这个词。所有超声波探头都工作在一个频段,相互之间回波还有干扰,只能时分复用。时分复用啊,老大们,12 个探头轮一圈,啥概念?几秒过去了。计算 4 个 4 个一组,也很慢。慢,就是超声波最大的问题。

第二个问题,就是长。一串超声波,就像一串萝卜。串在一根绳上。这根绳,连起来十几米长。长有什么不好,嘿嘿,笔者当年可是吃了大亏。肇庆某公司上海分舵一位大牛面试过笔者,说了句搞硬件就是提个指标的嘛。哎,没上车没吃过亏啊。

第三个问题,温湿度。超声波对温湿度极其敏感,要做一个详细的标定表,要不这个超声波就不灵了。

还有一个,就是误报问题,不想展开了。笔者只能说,简简单单一个超声波,就可以折腾你个一两年。所以,自动驾驶工程化是一条漫漫长路。等 ABCD,那可以洗洗睡了。

4. 视觉与毫米波的融合

特斯拉反应很快,立马就把毫米波用的妥妥的。知乎上有文章介绍关于激光雷达点云如何与图像如何融合以及联合标定。各大创业公司也乐于 Show 点云和图像的融合结果。

Coulson:视觉激光雷达信息融合与联合标定:

https://zhuanlan.zhihu.com/p/55825255

但是,能把毫米波和图像结合起来,足可以见特斯拉的算法能力之强。要用好毫米波,首先要拿到原始数据。

毫米波的原始数据是一条曲线,横轴是与天线阵面法向的夹角,纵轴是回波信号强度。有兴趣的朋友可以找一套 TI 的开发套件来看看。这个波形,人是看不懂的,所以就有了一大票人专门依据这个毫米波波形做信号处理,来提取目标,跟踪目标。

笔者看了特斯拉 Autopilot 的试驾视频,可以说,特斯拉的毫米波雷达和视觉的融合是稳定和到位的。

5. 定位

特斯拉用的定位模块很简单,UBLOX-M8L,都没有上 M8P。笔者在这里再一次膜拜特斯拉。可是,特斯拉的定位真的很牛啊。下面这个视频,主路在前方分成了主路和辅路,还都是高速。MODEL3 妥妥的提前切换到辅路上(6 分 10 秒开始),车主 High 翻了。这就是说,特斯拉妥妥的车道级定位。

Tesla Model 3 Autopilot on Navigation

这个定位是怎么实现的?笔者认为有两点:

- 车速较高,白天、环境开阔,M8L 的定位精度 CEP 在 1m 内。笔者写了个程序,边开车记录自己的坚果手机的定位轨迹,定位精度不差。

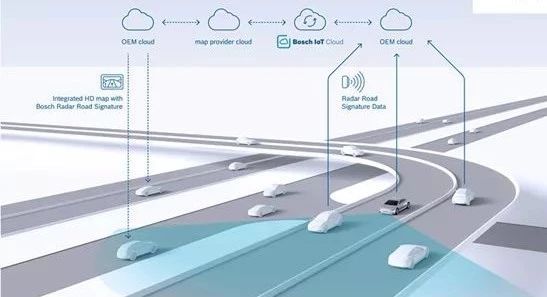

- 特斯拉用毫米波做了定位。马路两边的金属栏杆和路灯是比较好的特征,可以做出类似激光雷达的匹配定位,但精度会差。

https://techcrunch.com/2017/06/07/bosch-to-create-radar-road-signature-maps-for-high-accuracy-self-driving/

6. Tesla方案存在的问题

特斯拉的方案主要依靠视觉,所以 Tesla 的环境感知三维重建是基于二维的。二维转换为三维,必然有信息丢失。笔者通过看视频,发现 Tesla 对远处的物体有误识别的情况。特别是这种情况:一个行人,在晚上,穿着黑衣服,突然从路边窜出来。毫米波看人本来就不行,超声波又太近,视觉是两眼一抹黑。别说各种视觉欺骗了。

横向运动的两个车,定位的不好

09:02 这两个黄框不是人,误识别了用

用Tesla Autopilot的眼睛游览巴黎(高速篇):

https://v.qq.com/x/page/l07925gsykb.html

基于视觉的方案,主要问题有:

- 不省时间。我在linkedIn上搜到了 1000 个做 TESLA、Vision 相关的工程师,不全部都是现员工。不过也可以看出人手不少,开工资得多少钱啊。说明这个视觉的路线,一点都不好做。其他车厂要照着这个路子从 0 做,恩,准备 2030 年量产吧。

- 不省钱。人力成本是一块。硬件成本也不便宜,这么多摄像头,需要GPU的算力支持。笔者刚买了块 GTX1060,1700 RMB,这还只是消费级产品,市场的量也不小。如果是车规的 ECU,还要达到 ASIL-D,一点都不便宜。不过在激光雷达和 ECU 中间,我宁肯选 ECU,CMOS 工艺啊!激光雷达的核心器件是 III-V 族工艺。

综合上述两点,Tesla 适合交通参与者较单一、路面情况较简单的结构化道路。也就是高速和人车分流的园区。但是,量产车能在高速上实现自动驾(L2 级别),确实很赞!此外,特斯拉的最大优势在于量产的50万辆AP车在路上跑,为其积累竞争对手无法获得的海量实际运行数据。

广告

广告