自动驾驶汽车能够提高交通效率和安全性的一个重要前提是,系统能判断人类驾驶员的意图,并且不断地适应人类驾驶员的驾驶风格。麻省理工学院计算机科学和人工智能实验室(CSAIL)近期的最新研究成果显示,研究人员将社会心理学集成到自动驾驶汽车的决策中,以量化和预测其他司机的社会行为。后台回复“SVO”获取全部研究材料。

研究简介

麻省理工学院计算机科学和人工智能实验室(CSAIL)的研究人员在研究是否可以对无人驾驶汽车进行编程,以对其他驾驶员的社会性格进行分类,以便更好地预测不同的汽车会做什么。具体来说,他们使用了一种称为“社会价值取向(Social Value Orientation,SVO)”的东西,它代表某人的自私(“egoistic”)与无私或合作(“prosocial”)的程度。然后,系统估算驾驶员的SVO,以创建自动驾驶汽车的实时驾驶轨迹

研究人员将各个智能体之间的交互建模为一个最佳响应博弈,其中每个智能体协商以最大化自己的效用。研究人员通过寻找纳什均衡来解决动态博弈,得到了一个在线预测多智能体相互作用的方法。这种方法允许自动驾驶车辆观察人类驾驶员,估计他们的SVOs,并实时生成自动控制策略。研究人员在具有挑战性的交通场景如合并车道和无保护的左转弯中的能力和性能演示了他们的算法。研究人员在仿真和NGSIM数据集中的人工驾驶数据上验证了研究结果。研究结果显示了该算法的行为如何适应其他司机的社会偏好。通过集成SVO,本研究提高了自动驾驶的性能,减少了25%的人类轨迹预测误差。

很遗憾的是,该系统还不够强大,无法在实际道路上实施。但该系统可以让无人驾驶汽车实际学习表现出更多类似于人类的行为,这将使人类驾驶员更容易理解。研究人员维尔克·施瓦汀(Wilko Schwarting)说:“与人类以及周围的人共同参与交通,意味着要弄清他们的意图,以更好地理解其行为。”研究成果论文《Social Behavior for Autonomous Vehicle》已于近日在《美国国家科学院院刊》刊出。

文章概述

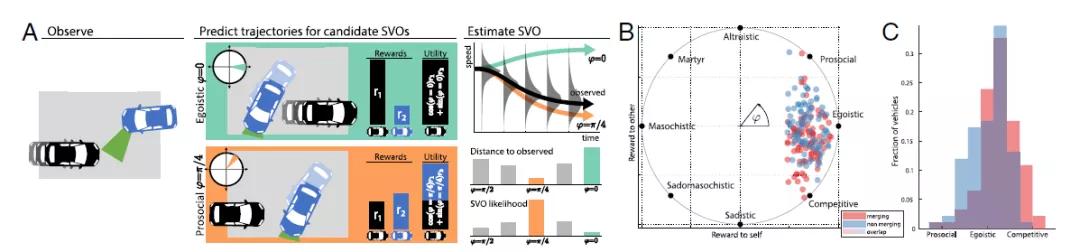

图1 了解司机的SVO有助于预测他们的行为

上图A中,AV(蓝色)观察另一个人的轨迹(黑色)。基于效用最大化决策模型,可以预测候选SVOs的黑色车辆的未来运动轨迹。如果人类司机是自私的,他们不会屈服,AV必须等待转弯。如果人类司机是合作的,他们就会让步,AV就可以安全地转向。在这两种情况下,驱动都是效用最大化,但是效用函数随SVO而变化。一个自私型的司机在计算其效用时只考虑自己的回报。一个合作型的司机把它的奖励和另一辆车的奖励放在一起衡量。AV通过最可能的SVO估计来预测未来的运动可能性。

上图B中,SVO被表示为一个角度偏好,它关系到个体在社会困境场景中的权重奖励。在这里,研究人员绘制了在NGSIM数据集中融合的驱动程序的SVOs估计值,并在方法和结果中进行了说明。

上图C中式交互作用期间平均SVO估计数的分布情况。图中结果表示合并驱动程序(红色)比非合并驱动程序(蓝色)更具竞争力。

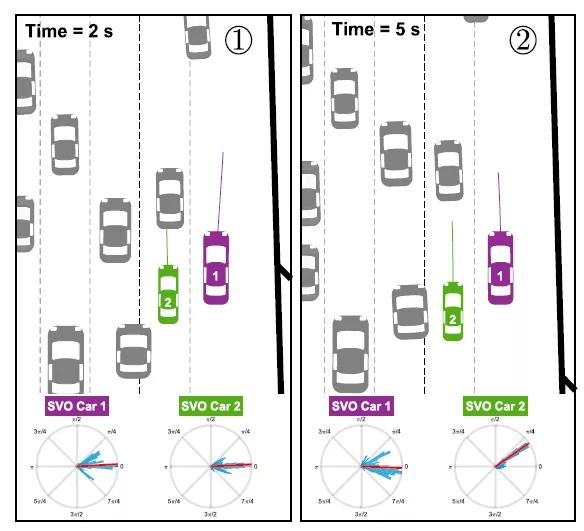

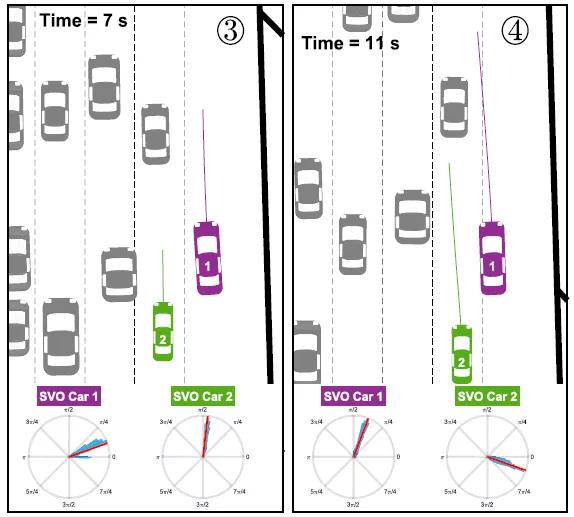

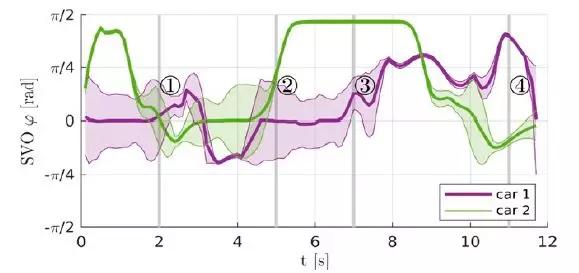

图2 车道合并场景

上图中,car 1(紫色)正在尝试合并,并且必须与car 2(绿色)产生交互。实线表示算法预测的轨迹。对于每一帧的SVO估计,蓝色代表分布,红色代表我们的估计。折线图中,实线表示SVO随时间的估计,阴影区域表示置信界限。最初,car 2不与car 1合作,不允许它合并。可以看出,几秒钟后,car2变得更倾向于合作型,相应的,它并允许car 1合并。

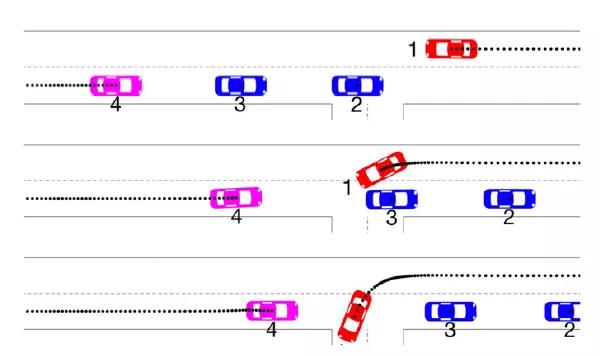

图3 无保护的AV左转弯场景

上图表示,当AV接近十字路口时,红蓝两辆自私型的车互不让步。第三辆合作型(无私型)的车减速,允许AV完成转弯。

展望

当今自动驾驶汽车的一个中心问题是,它们被编程为假设所有人的行为方式相同。尽管这种谨慎措施减少了致命事故的可能性,但同时也带来了一定的困扰,这也是为什么大多数交通事故都涉及到急躁的驾驶员追尾的主要原因之一。下一阶段,该团队计划将其模型应用于行车环境中的行人,自行车和其他人员。此外,他们还将研究其他在人类之间起作用的机器人系统,例如家用机器人,并将SVO集成到他们的预测和决策算法中。研究人员乐观地表示,“通过对驾驶人进行建模,并使用SVO在数学模型中将模型合并到机器人汽车的决策模块中,这项工作将会使人为决策和系统决策的自动驾驶汽车之间更安全,为道路共享打开了大门。”

Ref:

https://www.csail.mit.edu/news/predicting-peoples-driving-personalities

广告

广告