NHTSA特斯拉调查报告解析

作者简介

钟娟 ,复睿微电子自动驾驶算法专家,毕业于中国科学院,曾就职于清华大学联合研究所,先后担任资深算法专家、系统架构专家,长期从事图像算法和人工智能领域科学研究工作。

自动驾驶,是一个根植于人类内心深处的梦想,在人工智能大浪潮的推动下,自动驾驶逐渐从科幻电影的场景中走向了真实世界。自动驾驶的初衷是为人类提供一种快速、精准、安全的出行方式。然而,当前的自动驾驶技术远没有想象中那么美好,自动驾驶事故屡见不鲜。

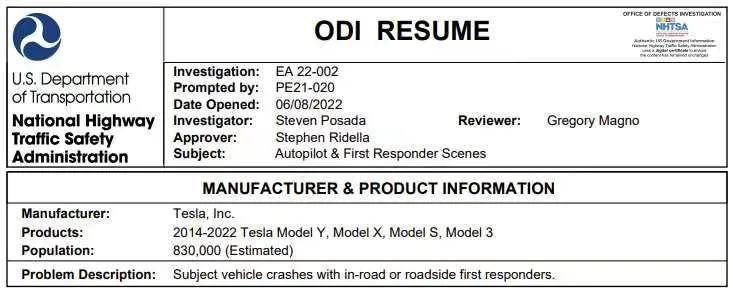

今年6月初,美国高速公路安全管理局(NHTSA)发布了一份特斯拉自动驾驶事故调查报告。报告主要有以下几个关键点:

-

发生事故的车辆为L2级别

-

自动驾驶系统在撞击前不到1s中止了车辆控制

-

自动驾驶开启情况下,撞上了高速上的静止车辆

特斯拉的Autopilot是一套高级驾驶辅助系统(ADAS),处于国际汽车工程师学会(SAE)提出自动驾驶等级中的L2,距离完全自动驾驶L4+级仍有距离。L2是一个非封闭完整的自动驾驶功能,这种级别的自动驾驶车辆要求驾驶员保持对环境的监测,随时能够接管车辆,这中间存在模糊的责权划分。如果把责任都交给自动驾驶程序,受到能力的限制,当遇到特殊情况,比如前车突然刹车或者出现交通事故时,L2级别辅助驾驶包含的AEB自动紧急刹车系统应对方向相对有限,大多数车型的AEB唯一能做的就是紧急制动。在高速运行的情况下,这种机制不可避免地会与其他车辆或障碍物发生碰撞。

NHTSA的调查报告中表明,特斯拉自动驾驶在大多数碰撞事故发生前启动了向前碰撞警告(FCW),随后的自动紧急制动(AEB)在大约一半的碰撞事故中起了作用。但在碰撞事故中,平均来说,Autopilot在实际撞击前1秒内中止对车辆的控制,没有给驾驶员足够的响应时间。调查报告还表明司机在大约8秒内注意到了前方事故(一般人眼能看清250~270米外物体的轮廓),在事故发生前的2-5秒内,没有司机采取规避措施,司机的手都放在方向盘上,大多数司机都遵守了特斯拉自动驾驶的相关规定。对于这种情况的发生,我们认为可能有以下两方面的原因:一是纯视觉方案的感知能力不足,二是决策部分存在安全相关的缺陷。从1秒内这个时间点来看,更像是感知能力的问题,视觉感知系统没有及时地识别出危险场景(静止物体),搭载了毫米波雷达的自动驾驶系统在离障碍物较远时选择过滤掉静止物体,当距离足够近时,系统认可了毫米波雷达的探测结果,发现障碍物并退出自动驾驶,把车辆控制权交给驾驶员,但为时已晚。

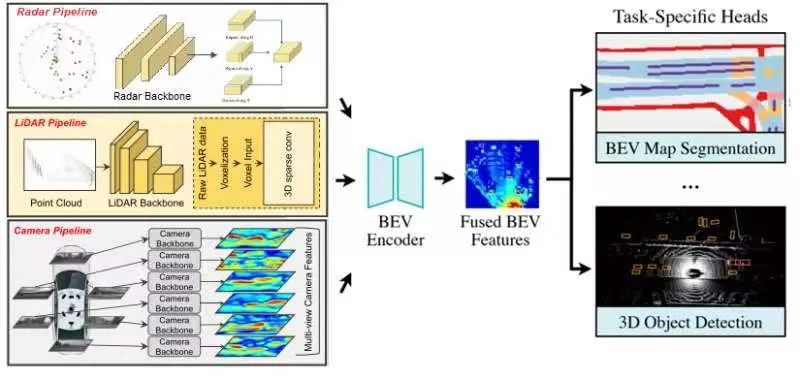

道路上的静止物体是自动驾驶技术升级路上的一大障碍,NHTSA的调查报告指出特斯拉11起事故多发生在夜间,所撞车辆包括停靠在路边的警车、巡逻车、消防车以及侧翻的事故车,基本都属于已有交通事故后的二次碰撞。这些事故的发生一方面体现了感知模型对于Corner case(长尾问题)泛化性不足,另一方面也暴露了目前的纯视觉自动驾驶方案感知冗余度不够的问题。自动驾驶需要多传感器融合技术,多传感器融合是对来自不同信息源的感官数据进行集成的过程。它是自动驾驶、物联网、机器人等自主感知系统的组成部分。利用不同传感器获取的互补信息,融合有助于降低状态估计的不确定性,做出更全面、更准确的预测。

2022年6月7日,特斯拉向FCC联邦通讯委员会提交了毫米波雷达的相关材料。这意味着,特斯拉实际上没有放弃毫米波雷达,一直在做这方面的研究。这次特斯拉选择的是一款自研的4D毫米波雷达,毫米波雷达在测距测速方面远高于视觉系统,可靠性更高。除此之外,激光雷达由于其探测距离远、抗干扰能力强、能准确获取物体的三维信息,也被很多自动驾驶厂家采用。国内车厂有将4颗128线激光雷达搭载在自动驾驶车上,配上2颗4D毫米波雷达、7个8M摄像头以及12颗超声波雷达,把智能硬件直接拉到天花板,对芯片的算力也提出了更高的要求。硬件的升级能在某种程度上提升一定的性能,雷达与摄像头的结合可以提高一些静态障碍物的识别精度,但光有硬件的升级并不能解决感知的问题,算法的升级也势在必行。

目前ADS算法正在从多传感器决策层后融合向特征级前融合转化。决策层后融合算法中各个传感器分别做感知任务,分别得到各自的感知结果后做融合。这种单兵作战的方式,算法相对灵活,数据处理简单明了,但各传感器相互独立,缺乏必要的联系,决策过程中还要做取舍和判断,容错性较差。特征级前融合是指用不同的方法提取各传感器的特征,然后在BEV(鸟瞰图)的视角下做特征融合,继而在BEV特征图上完成感知任务。特征级前融合网络有效地将各类传感器的特征融合在一起,可以实现端到端的三维检测,省去了复杂的特征匹配过程。有研究结果表明,采用前融合的方式,雷达能有效地提升纯视觉方案的性能,譬如能检测到更远距离的车辆、更好地检测小物体、更有效的检测被相机截断的大物体,同时降低误检率。特征级前融合采用CNN、RNN、Transformer、GNN多网络结构的组合,算法的复杂度也大幅提升,对硬件的算子和算力都提出了新的挑战。

自动驾驶主要分为三部分:环境感知、决策规划、控制执行。早些年,受芯片算力的限制,自动驾驶需要在模型的轻量化和精度上做平衡,无法达到高精度的感知,继而无法做更合理的规划控制。自动驾驶安全事故的原因中,环境的感知系统失效是主要问题。近年来,大算力芯片发展迅猛,芯片算力也从几个TOPS增加到了几百甚至上千TOPS,芯片算子除了传统的卷积网络以外也开始考虑稀疏矩阵、矢量计算以及片内存储的设计。有了算力的支持,感知算法可以选择更大的骨干网络来提取特征、采用浮点计算替代定点、复合神经网络组合设计也更自由,这些都能提高感知的精度,继而提高自动驾驶的性能。目前出现事故的所谓 “自动驾驶”往往是L2级别的车辆,还属于半自动的辅助驾驶。自动驾驶性能需要进一步提升至L3或L4甚至是L5,L4级别自动驾驶的算力需求已经突破1000 TOPS,L5级别的算力估计在2000 TOPS以上。

“正入万山圈子里,一山放过一山拦”,没有人愿意看到交通事故的发生,在自动驾驶的道路上我们会碰到各种各样的难题,任何一次技术的革新都并非一帆风顺。大算力芯片是自动驾驶的第一生产力,是自动驾驶通往L3、L4以及L5级别的基石。

关于复睿微电子

复睿微电子是世界500强企业复星集团出资设立的高新技术企业。复睿微电子植根于创新驱动的文化,通过技术创新改变人们的生活、工作、学习和娱乐方式。

公司成立于2022年1月,目标成为世界领先的智能出行时代的大算力方案提供商,致力于为汽车电子、人工智能、通用计算等领域提供以高性能芯片为基础的解决方案。

目前主要从事汽车智能座舱、ADS/ADAS芯片研发,以领先的芯片设计能力和人工智能算法,通过底层技术赋能,推动汽车产业的创新发展,提升人们的出行体验。在智能出行的时代,芯片是汽车的大脑。复星智能出行集团已经构建了完善的智能出行生态,复睿微是整个生态的通用大算力和人工智能大算力的基础平台。复睿微以提升客户体验为使命,在后摩尔定律时代持续通过先进封装、先进制程和解决方案提升算力,与合作伙伴共同面对汽车智能化的新时代。

参考文献:

-

1. INOA-EA22002-3184 NHTSA特斯拉事故调查报告2. 3D-CVF: Generating Joint Camera and LiDAR Features Using Cross-View Spatial Feature Fusion for 3D Object Detection3. BEVFusion: Multi-Task Multi-Sensor Fusion with Unified Bird’s-Eye View Representation

- 下一篇:ECU量产测试,拆解测试系统“标准化”的玩法

- 上一篇:充电站无线通讯验证方案

编辑推荐

最新资讯

-

中汽中心工程院能量流测试设备上线全新专家

2025-04-03 08:46

-

上新|AutoHawk Extreme 横空出世-新一代实

2025-04-03 08:42

-

「智能座椅」东风日产N7为何敢称“百万级大

2025-04-03 08:31

-

基于加速度计补偿的俯仰角和路面坡度角估计

2025-04-03 08:30

-

《北京市自动驾驶汽车条例》正式实施 L3级

2025-04-02 20:23

广告

广告