基于特征鲁棒性增强的多摄像头下车辆识别方法

论文基本信息

01.拟解决的问题和创新点

为缓解在多摄像下车辆识别能力的不足的问题,本文在transformer 框架下提出了一种基于结构信息增强的车辆识别方法。

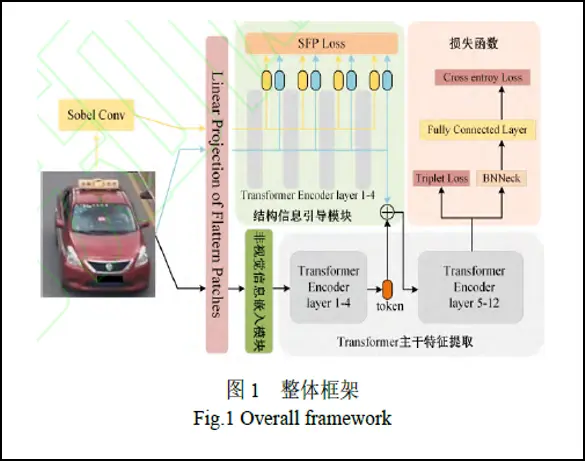

考虑到轮廓特征可以有效的描述车辆的结构信息,设计了一个轮廓特征增强模块,在特征空间中提高了网络对纹理信息提取的能力。

提出一种新的结构特征感知损失,约束特征尽可能有效地融合结构信息。

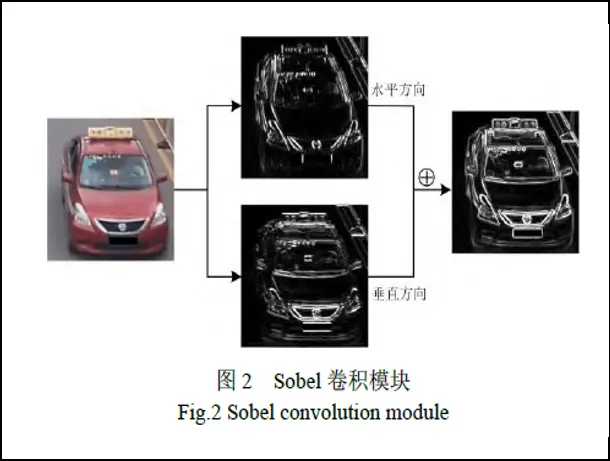

提出一种属性信息嵌入模块,可以将车辆的非视觉信息,例如车辆的方向信息和类型作为矢量嵌入到transformer 框架中,以此消除摄像头带来的视角偏差。

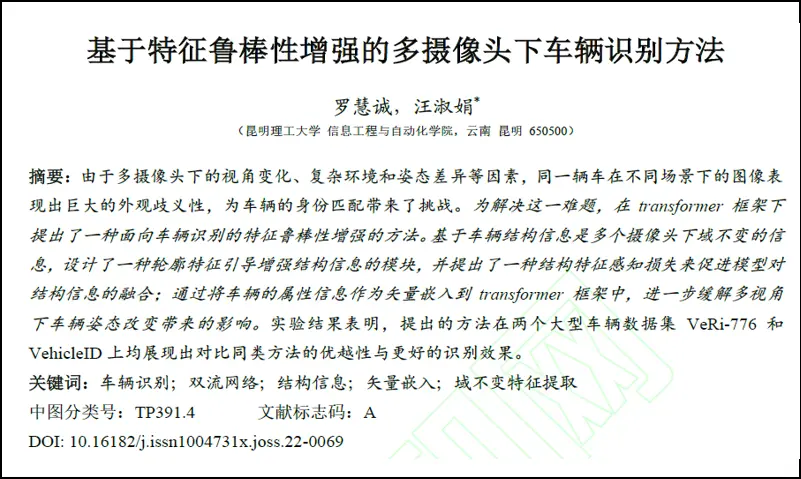

02.技术流程图

03.模型介绍

采用双流的网络结构,分为主干网络和分支网络,主干网络用于学习车辆的类别信息,分支网络用于学习车辆的结构信息。

04.模型对比结果

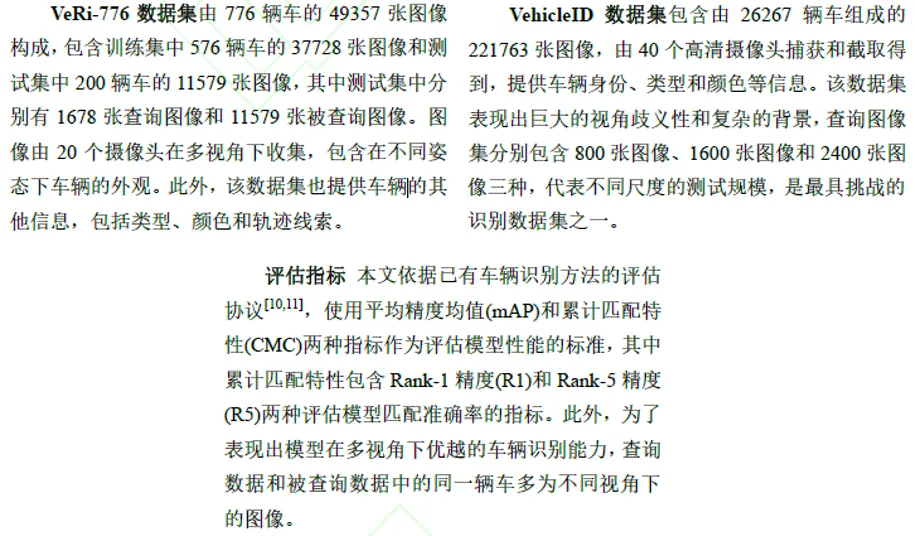

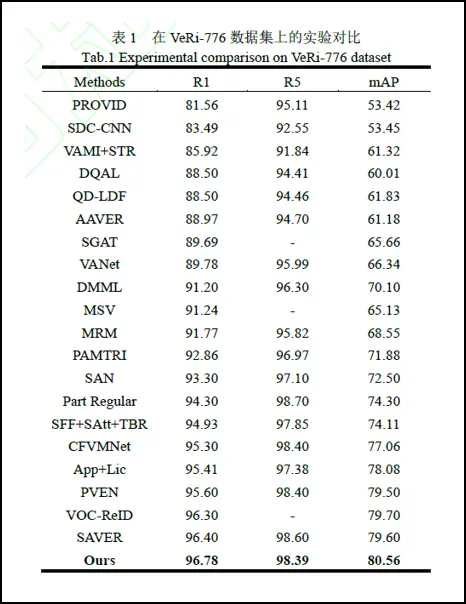

数据集和评估指标

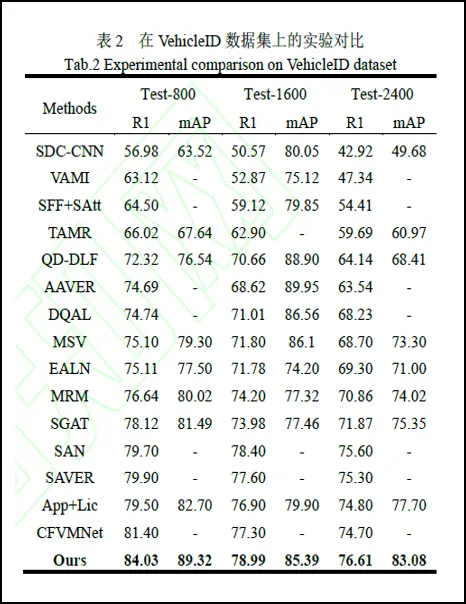

对比实验结果

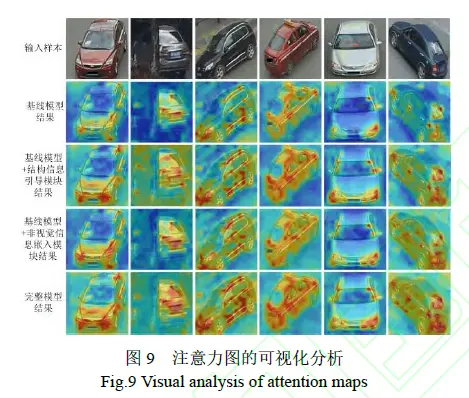

05.注意力图仿真实验

06.结论

本文提出了一种transformer 框架下判别性信息增强的车辆识别方法,可以在多摄像头不同视角的领域空间中提取鲁棒性的识别特征。该方法先使用结构信息引导模块提升特征对于车辆轮廓信息的感知能力,同时引入一个新的结构特征感知损失,约束支路网络提取到更全面的轮廓信息,并通过特征融合的方式使主干网络能提取支线网络得到的轮廓信息。

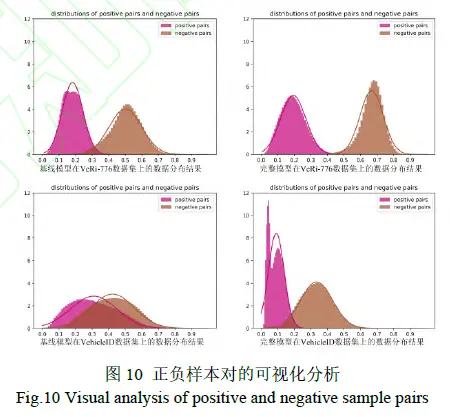

本文设计了一个非视觉信息嵌入模块,将车辆的属性信息(车辆方向和类型信息)嵌入到主干网络中,进一步解决了多摄像头下不同视角带来的车辆外观姿态不一致的问题。该方法在VeRi-776 和VehicleID 数据集进行了充分的实验,并与最新的车辆识别方法进行了详尽的对比,结果显示本文提出的方法表现出显著的性能提升和优越的识别能力。

本文主要围绕跨视角的监控视频下车辆的姿态差异问题展开研究,并提出了不同的模块赋予网络在多视角下依然具有提取鲁棒性特征的能力,在交通监管、犯罪追踪和车辆监控等方面具有广阔的应用前景。

本文的研究工作存在一些未解决的问题,需要未来的进一步深入。在实际场景中,车辆往往遭遇被物体遮挡的情况,例如,路边来往的行人、周围经过的车辆以及路标和车站等建筑物。当车辆被遮挡时,提取到的特征通常带有遮挡物的信息,缺乏判别性。因此,设计出有效的模型应对车辆被遮挡的情况,使用注意力机制或局部特征补充策略等方法只关注车辆未被遮挡的部分,从而提取出更具有判别性的特征,是未来车辆识别发展的重要趋势。此外,随着监控设备的进一步升级,大部分现有的监控摄像头具有夜视功能,夜间拍摄到的车辆图像多为红外图像,与仅在白天的车辆识别相比,跨白天和黑夜不同模态的图像检索与匹配更具有挑战性。

编辑推荐

最新资讯

-

大卓智能端到端直播实测,16公里复杂路段挑

2025-04-25 17:16

-

《汽车轮胎耐撞击性能试验方法-车辆法》等

2025-04-25 11:45

-

“真实”而精确的能量流测试:电动汽车能效

2025-04-25 11:44

-

GRAS助力中国高校科研升级

2025-04-25 10:25

-

梅赛德斯-AMG使用VI-CarRealTime开发其控制

2025-04-25 10:21

广告

广告