基于结构化的Informer模型的自动驾驶轨迹预测

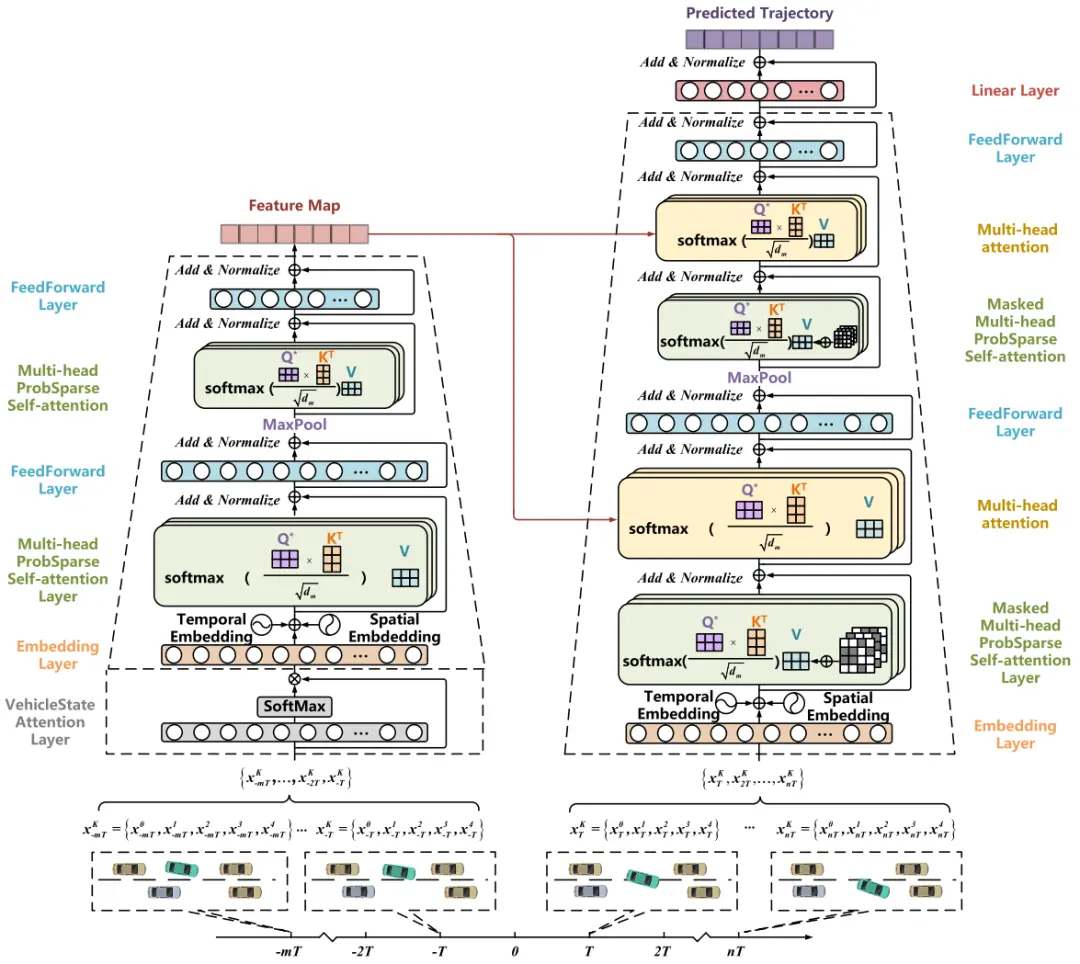

本文利用Transformer模型演变而来的Informer模型来预测TV的运动轨迹。如图3所示的Informer架构是基于编码器-解码器框架[28][29]。编码器-解码器结构分为两部分:编码器层和解码器层。前者接收所有车辆的历史轨迹来分析它们之间的相互作用,包括每个车辆的轨迹点之间的相互作用。然后编码器将这些输入信息转换成特征图,该特征图表示编码器对输入历史轨迹的理解和细化。后一部分接收车辆未来的真实轨迹,这被认为是地面实况。解码器建立特征图与地面实况之间的联系,最终生成未来轨迹。此外,我们在编码器的最外层设计了车辆状态关注层(vehicle-state-attention layer),用于感知车辆状态变化。车辆状态注意层的输出之后是嵌入层,这一层也被解码器所采用。嵌入层的作用是在时间和空间上嵌入输入的车辆轨迹序列。这些组件将在后面的章节中进行详细阐述。

图 3 Informer架构

图3中:左边是编码器,右边是解码器。所有历史轨迹在经过车辆-状态-注意层后被输入编码器。编码器通过嵌入层向输入轨迹添加时间和空间特征。嵌入层的输出连接到两个多头ProbSparse自关注层和前馈层,生成到解码器的特征映射。解码器与编码器类似地处理地面真实轨迹,但解码器具有多头注意层,用于分析来自编码器的特征映射与地面真实之间的联系。最后,由解码器生成预测轨迹。

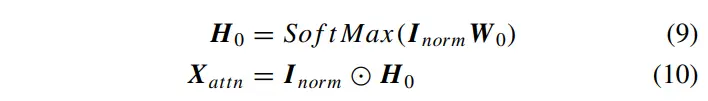

1)Informer-Vehicle-State-Attention:考虑到历史轨迹中纵向和横向状态的变化会对未来的轨迹产生不同的影响,本文设计并放置了车辆-状态-注意机制在Informer-encoder网络的第一层。其任务是在每个时刻为车辆输入状态的每个部分分配不同的注意力。例如,当TV想要变道时,车辆-注意力机制会将更多的注意力分配给侧向状态,从而使下一个Informer特征提取操作将更多地考虑车辆的侧向运动。注意层是根据下面的等式来计算的

其中为车辆-状态-注意力层权重,函数用作激活函数,将其输出归一化,所有元素都在0到1之间,并求和为1; 是关注权重矩阵,表示对车辆状态的不同关注值; 表示矩阵对应元素的乘法,为注意力分配后的初始历史轨迹。通过观察车辆-状态-注意力层,可以得到网络对输入状态各部分的注意力,这有助于理解网络更关注哪个物理特征。在一定程度上,它解释了预测轨迹与输入历史轨迹之间的连接特征。

2)Informer-Embedding:基于RNN的预测模型可以通过依次计算时间序列的每个节点来分析节点之间的时间关联,与之相反,基于transformer的Informer对输入时间序列的每个节点进行并行处理,因此无法识别节点之间的顺序来分析序列的时间关联[29]。因此,在本文中,编码器的历史轨迹和解码器的目标轨迹被嵌入到一组时间特征中,并融合到输入序列中。

输入轨迹已经被分配了车辆注意力,它包含了5s的历史轨迹信息。由于数据集的采样时间为0.1s,因此输入轨迹有50个时间序列节点。正弦和余弦使用函数嵌入50个节点,如下所示:

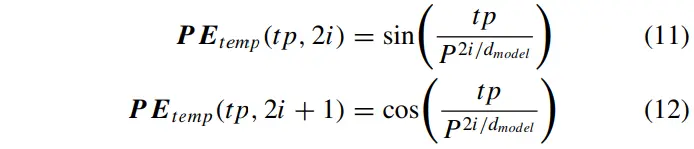

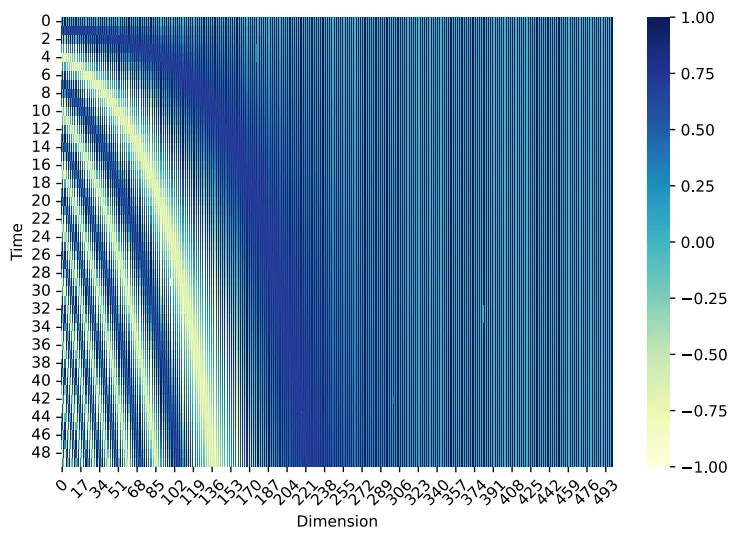

式中为嵌入的时间特征矩阵。表示时间序列位置,取,,的值;表示时间特征向量的维数;是时间特征向量维数,取,,的值。为常数,为保证每个节点的时间特征向量唯一,其值应远大于,取10000,如[29]所示。时间嵌入过程的结果如图4所示。在此过程中,正弦和余弦函数交替使用,随着时间特征向量的维阶数逐渐增加,函数周期变化的影响逐渐减小,从而为时间序列的每个节点产生不同的纹理特征,目的是便于网络学习时间序列节点之间的依赖关系。

图 4 时间嵌入特征

最新资讯

-

大卓智能端到端直播实测,16公里复杂路段挑

2025-04-25 17:16

-

《汽车轮胎耐撞击性能试验方法-车辆法》等

2025-04-25 11:45

-

“真实”而精确的能量流测试:电动汽车能效

2025-04-25 11:44

-

GRAS助力中国高校科研升级

2025-04-25 10:25

-

梅赛德斯-AMG使用VI-CarRealTime开发其控制

2025-04-25 10:21

广告

广告